グラス型デバイス(メガネ型デバイス)が注目を集めはじめている。「XREAL Air」シリーズに「Rokid Max」や「Virture Pro」、「Ray-Ban Meta」などが次々に登場。「しょっちゅう使っている」という人も、じわじわと増えはじめているようだ。

グラス型デバイスといっても、用途や機能は様々だ。空間に2Dディスプレイを展開するデバイス、視覚的な表示機能はカットした代わりに、音声操作でAIとの連携や写真・動画撮影ができるデバイス、リアルタイムでの自動翻訳を字幕で出すことに特化した単色表示のデバイス……などなど。筆者もグラス型デバイスをいくつか持っている。

(左上は「XREAL Air 2」、右上は「Rokid Max」、左下は「Ray-Ban Meta」、右下は「Virture One」。いずれも「グラス/メガネ型」だが、メーカーはもちろん、主な利用方法や接続先になるデバイス、機能などは似ているものもあれば大きく異なるものもある。 左下写真はMogura VR News撮影、それ以外は各社公式Webサイトなどより引用)

しかし、こうしたグラス型デバイスには共通の課題があると感じている。具体的に言うと「操作」や「入力」だ。

スマートフォンをコントローラー代わりにするケースもあれば、メガネの「ツル」部分がタッチやスワイプ操作になっているケース、音声での操作が推奨されているケースもある。だいたいのグラス型デバイスは、こうした操作方法を単独で、または組み合わせて搭載している。

そして、いずれも「スタンダード」にはなりきれていない。わざわざスマホなどを取り出さなければいけなかったり、腕を上げてボタンに触れる必要があったり、ズレたグラスを直そうと手を伸ばすとタッチパネルが誤動作したり……音声操作も、人混みの中では認識してもらいにくいと感じることもある。

2024年6月に米国で開催された世界最大のXRカンファレンス「AWE USA 2024」では、こうしたグラス型デバイスの操作に向けて、様々な方法で「答え」を提示しようとする企業が見かけられた。今回、アプローチの可能性として非常に興味深いので紹介しよう。

手首に装着するデバイス「TAP XR」

米国とイスラエルに拠点を置くスタートアップTap Systemsの「TapXR」は、手首に装着する腕時計のようなウェアラブルデバイスだ。バンドと組み合わせて手首に巻き付けて使用する。

このデバイスにはカメラが搭載されており、手首の裏側から指の動きを認識する。つまり手首に巻くだけで入力ができるわけだ。手を真下に下ろしていても使えるのは嬉しい。

また搭載されているIMUセンサーで手首の向きや動きも認識しており、カーソルの移動などもできる。指を大きく動かさなければいけないが、感度は良好だ。

この「TapXR」は、Bluetooth接続でトラックパッド付きのキーボードとして認識させることもできる。もし外部キーボードを認識するデバイスであれば、それをすぐに使えるようだ。動かす指の組み合わせによっては、文字入力にも対応する。

この「TapXR」はすでに第二世代のデバイスになっているという。初代「TapXR」はそれぞれの指にセンサーをつけて入力するデバイスだったが、今回はアプローチをガラリと変えた。すでに日本ではAmazonで販売中であり、購入も容易なようだ(転売品が出回っているケースもあるので注意。公式Webサイトの通販では179ドル、執筆時点では3万円に届かないくらいの価格だ)。

(上は第二世代「TapXR」で、下が第一世代「TapXR」。こうして見ると変わりように驚く)

スマートウォッチで操作、デバイス不要の「wowmouse」

スマートウォッチのセンサーデータを活用するアプローチもある。Doublepointがそうだ。ユーザーが日々装着しているスマートウォッチに「wowmouse」(※記事執筆時点ではAndroid向けのみ)というアプリをインストールし、簡単な操作をタップなどで可能にする。

できる操作は、いわゆる指をつまむ「ピンチ」操作や、ピンチしたまま動かしての「ドラッグ」操作など。ごく簡単な入力しかできないが、音楽の再生や電話の応答、AIのウェイクワード(「Hey, Siri」など)代わりにするなら、これで十分かもしれない。ただし、同社のリリースしているSDKを使ってアプリケーションを対応させる必要がある(wowmouseにアプリが対応していなければ使えない、ということだ)

センサーはスマートウォッチに搭載されているものに依存するため、対応機種が限られるのはややネック。2024年6月時点では、Androidの「Wear OS 2」以降のスマートウォッチで動作するが、推奨機種はSamsung Galaxy Watch 4 / 5 / 6、Pixel Watch 2などに限られている。Apple Watch(WatchOS)には対応していない。しかし、対応範囲は徐々に拡大中。期待が持てそうだ。

Vision Pro方式でハンドトラッキングを拡張するUltraleap

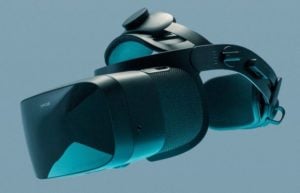

Appleが2024年2月に発売した「Vision Pro」では、腕を目の前に上げる必要がない。座って手を膝に置いたまま指を動かしても操作できる。これはVision Proの下部に搭載されているセンサーやカメラが、指の動きを認識しているからだ。

(Vision Proは大量のセンサーやカメラを搭載することで、非常に快適な指・視線での操作を実現している)

そして、より小型なグラス型デバイスで同様のアプローチをかけている企業がある。ハンドトラッキング業界では非常に良く知られている、イギリスのUltraleapだ。

Ultraleapはハードウェア・ソフトウェア双方の開発を手掛けており、様々なヘッドセットや、企業向けのハイエンドなデバイスでも採用されている。個人・小規模開発者でも購入しやすいハードウェアをリリースしており、信頼は厚い。

さて、AWE USA 2024で彼らがプロトタイプとして展示していたのは、「Ray-Ban Meta」の側面に下向きの小型カメラを取り付け、指の動きを認識するというもの。このカメラはフランスのカメラメーカーのものを採用している。彼らが言う通りかなり小さく、Ray-Ban Meta本体のカメラと大きさはそれほど変わらない。

(おそらく3Dプリンタなどで成形したパーツとカメラを組み合わせている。ややツルが太くなるが、コンセプトを体験・理解するには十分だ)

今回はプロトタイプということで、認識精度にはまだ課題はあるものの、Vision Proとかなり近い感覚で操作ができた。

(Spotifyで音楽再生の操作をしている様子)

デモでは、Ray-Ban Metaでのハンドトラッキングを実現するため、カメラ以外にも専用のRaspberry Piを有線で接続している。これはRay-ban Metaがカスタマイズできないデバイスだからであり、「将来的にはデバイスにカメラを組み込み、デバイスのプロセッサで処理を行う事を考えている」とのこと。すでにARグラスを積極的に展開しているTCLとのプロジェクトを進めているとのことで、今後の展開が楽しみだ。

(Ray-Ban Metaはカスタマイズを受け付けていないため、現状は外付け。将来的には内蔵するレベルまで小型化・省電力化・効率化することを目指しているという)

デファクトはまだ分からない、逆に言えば「面白い」時期

今回は「グラス型デバイスの操作・入力」をテーマに、AWE USA 2024で展示されていた複数のアプローチを紹介した。

もちろん、ARグラスの操作や入力のために取り組んでいる企業はまだまだある。例えばMetaは買収したCTRL Labの技術を使い、リストバンド型の筋電コントローラーの研究開発を長期間にわたって行っており、その成果を公表したこともある。(ちなみに脳波操作デバイスも研究中だが、MetaのCTOは「商品レベルに達するのはだいぶ先だろう」とコメントしている)

かつてスマートフォンが登場したとき、スティーブ・ジョブズは「人間が生まれ持ってきた指こそ、最高のコントローラーだ」と語り、タッチパネルを全面に採用し、スマートフォンの操作体系を確立させた。

では、XRではどうか? Magic LeapやAppleが打ち出した「空間コンピューティング」という言葉で形容されるように、XRは必然的に3次元的なインターフェースを生み出し、またそれに対応した操作体系や入力を必要とする。コントローラーなのか、音声なのか、指なのか、はたまた筋電位や脳波なのか……。

有力な答えはまだ出ておらず、みな模索と試行錯誤を続けている。すると、これは「おもしろい時期」なのかもしれない。そして、XRに限らず、さらに有効活用される技術の芽生えもありうるだろう……と感じさせられた。

(了)